来源:正大期货 2024-07-30 08:20

扎克伯格展望,Meta AI助手使用率几个月后将逾越ChatGPT。

7月24日破晓,美国科技巨头Meta推出迄今为止性能最壮大的开源大模子——Llama 3.1 405B(4050亿参数),同时宣布了全新升级的Llama 3.1 70B和8B模子版本。

Llama 3.1 405B支持上下文长度为128K tokens,是全球迄今为止性能最壮大、参数规模*的开源模子,在基于15万亿个tokens、超1.6万个H100 GPU上举行训练,这也是Meta有史以来*个以这种规模举行训练的Llama模子。

因性能佳、开源、多方互助,现在所有Llama模子版本的总下载量已经跨越3亿次。研究职员基于超150个基准测试集的评测效果显示,Llama 3.1 405B可与GPT-4o、Claude 3.5 Sonnet和Gemini Ultra等业界头部模子相媲美,包罗亚马逊AWS、英伟达、微软Azure和谷歌云等25家头部公司与Meta杀青互助,引入Llama 3.1。

“这对于我们来说是久旱逢甘霖。”自力剖析师Jimmy告诉《中国企业家》。苦于缺乏耐久高质量的训练数据已久,全球AI领域的开发职员终于迎来了开源曙光。一样平常来说,较小的专家模子(参数规模在10亿~100亿)通常行使“蒸馏手艺”,也就是行使更大的模子来增强训练数据。但由于巨头OpenAI的闭源,此类训练数据的缺乏是各大模子配合的难题。

开、闭源之争一直是AI圈的中央话题。Meta首创人、CEO扎克伯格提到:“我信托Llama 3.1的宣布将成为行业的一个转折点”;360团体首创人周鸿祎也曾示意,开源社区群集全球上千家公司、数十万程序员和工程师,开发气力是一个闭源公司的数百倍。

扎克伯格开源Llama 3.1,逼急OpenAI

Meta宣布前一天,Llama 3.1的模子和基准测试效果已经在外洋的Reddit等社区上泄露,Llama 3.1的磁力链接也被撒播,“壮大”“开源”成为谈论区的高频词。

Llama 3.1包罗8B、70B和405B三种参数规模,其中超大杯4050亿版本,该系列模子上下文窗口增添到了128K,扩大16倍;增添了8种支持语言;提升了工具使用能力,支持搜索和Wolfram Alpha的数学推理;拥有更宽松的允许,允许使用模子输出改善其他LLMs。

事实上,开、闭源的大模子差距正在缩小。Meta在官博指出最新一代的Llama将引发新的应用程序和建模范式,包罗行使合成数据天生来提升和训练更小的模子,以及模子蒸馏——这是一种在开源领域从未有过的能力。在基准测试集中的显示险些可以媲美当前*闭源模子GPT-4o和Claude 3.5 Sonnet,而且所有版本都可以在官网下载使用。

Meta对Llama 3.1的结构在今年4月就有迹可循。那时Meta就透露说,正在开发人工智能行业的*款产物:一个性能与OpenAI等公司*的私有模子相媲美的开源模子。

相比于OpenAI对手艺细节的“惜字如金”,Meta此次不仅开放小助手应用在线试玩,还宣布了近100页的详细论文,涵盖了缔造Llama 3.1历程中的一切,好比训练数据、过滤、退火、合成数据,并透露Llama 4已在开发中。

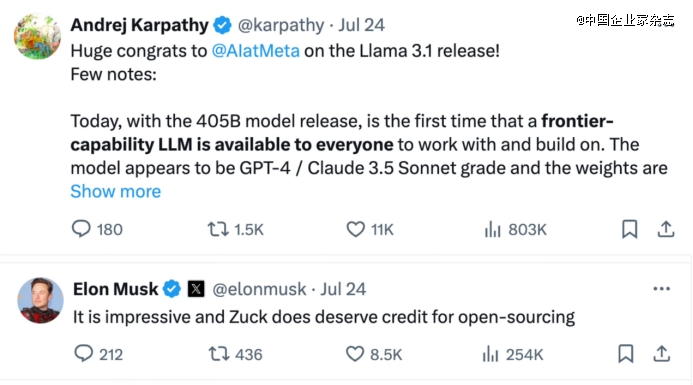

扎克伯格亲自为开源大模子Llama 3.1站台,在推特撰写长文《Open Source AI Is the Path Forward》强调开源的意义,他示意:“今天我们正迈出下一步——使开源AI成为行业尺度。”在特斯拉前AI总监关于Llama 3.1大模子的帖子下面,马斯克罕有识盛赞扎克伯格:“这令人印象深刻,扎克(伯格)的开源决议确实值得赞扬。”

泉源:马斯克回复推特截图

Meta与OpenAI划分代表着开源与闭源的两条手艺蹊径。关于开源和闭源的斗争由来已久,此前在彭博社的采访中,扎克伯格更是公然取笑:“阿尔特曼的向导能力值得赞美,但有点取笑的是公司名为OpenAl却成为构建封锁式人工智能模子的*。”

面临Meta这次的大招,OpenAI以低价战略应战。

Meta宣布Llama 3.1两个多小时后,OpenAI宣布新闻:公司推出了GPT-4o mini微调功效版,从现在到9月23日可免费使用。据领会,GPT-4o mini的输入tokens用度比GPT-3.5 Turbo 低90%,输出tokens 用度低80%。纵然免费期竣事,GPT-4o mini的价钱也比GPT-3.5 Turbo低一半。

价钱打折,但产物能力不打折。据领会,GPT-4o mini比经典版本GPT-3.5 Turbo能力更强,GPT-4o mini的上下文长度为65k tokens,是GPT-3.5 Turbo的四倍,推理上下文长度为128k tokens,是GPT-3.5 Turbo的八倍。

这就意味着,若使用GPT-4o mini微调版,就可以享受:以实惠的使用用度,使用更长的上下文、更伶俐的*大模子。阿尔特曼更是在推特发文示意,GPT-4o mini以1/20的价钱在lmsys上实现了与GPT-4o靠近的性能显示,他还希望人人能够多多使用GPT-4o mini 微调版本。

此次OpenAI以宣布GPT-4o mini 微调版为盾,不仅是对Meta开源大模子步步紧逼的还击,也同时将硅谷AI价钱战的火药味推得更浓。

用价钱“围剿”OpenAI

投资界24h | 文远知行赴美IPO了,估值370亿;共享单车集体涨价;武汉:将打造3000亿级母子基金群

纵然OpenAI推出可免费使用的小模子,但比起同为大模子的产物,Llama 3.1 405B的价钱比GPT-4o仍然要低许多。

公然数据显示,Llama 3.1的价钱在Fireworks平台上是每1百万tokens的输入/输出价钱是3美元,而GPT-4o每1百万tokens的输入价钱是5美元,输出价钱是15美元。此外,Claude 3.5 sonnet的每1百万tokens的输入价钱是3美元,输出价钱是15美元。

这不是硅谷在AI方面的*次“价钱战”。

今年5月,OpenAI宣布GPT-4o并支持免费试用,挪用API的价钱也比GPT-4-Turbo降低一半——打响了硅谷大模子价钱战*枪,同时这也是2023年起OpenAI的第4次降价。7月18日深夜,GPT-4o mini的正式亮相,与GPT-3.5相比性能更强,也更廉价,连阿尔特曼都曾建议人人不要再用GPT-3.5了。

用低价“围剿”OpenAI已成大模子公司们的老例。公然信息显示,与GPT-4o相对照,各大公司的最新宣布的产物划分是:Meta的Llama 3.1,谷歌的Gemini 1.5 pro,Claude 3 Sonnet,新近的Mistral AI,这些最新大模子价钱均低于GPT-4o。

国际头部大模子公司产物价钱表,信息泉源各大模子官网。制表:孙欣

而大模子的价钱战在海内也已最先。5月6日,初创大模子公司DeepSeek深度求索将输入价钱定为1元/百万tokens。紧接着智谱AI的GLM-3-Turbo模子、字节跳动的豆包大模子,以及阿里巴巴的通义系列模子、百度的文心一言模子纷纷跟牌。

低价,正在成为一种趋势。

小模子或将成为AI新风口

一直以来,大模子的生长受困于成本。斯坦福HAI研究所宣布的《斯坦福2024年人工智能指数讲述》指出,AI模子的培训成本已经到达了亘古未有的水平。例如,OpenAI的GPT-4估量使用了7800万美元用于盘算训练,而谷歌的Gemini Ultra破费了1.91亿美元用于盘算。2017年训练最初的Transformer模子的成本仅为约900美元。

而现在,小模子成了AI公司们降本增效的利器。

掀起新一轮价钱战前,OpenAI先手开卷小模子。7月18日,OpenAI宣布小模子GPT-4o mini,并称其为“迄今为止*成本效益的小模子”,正是上周(北京时间7月25日破晓)宣布免费使用的GPT-4o mini微调版的真身;苹果公司在Hugging Face上宣布了DCLM-7B开源小模子;不久后,英伟达和法国明星AI独角兽Mistral团结宣布了名为Mistral NeMo的小模子,称可以直接替换任何使用Mistral 7B的系统。

小模子,通俗来说就是比大模子处置数据能力略小的模子,可以明白为mini版的大模子。在AI领域,参数规模越大,大模子学习能力越强,诸如GPT-4这些模子通常拥有数十亿甚至数百亿的参数。然而据OpenAI先容,小模子GPT-4o mini在MMLU上的得分为82%,甚至某些显示优于大模子GPT-4。

对大部门用户来说,小模子是大模子的“平替”,*性价比。只管小模子在处置庞大义务上不具优势,但在小义务上具备更快的推理能力。同时对盘算机存储需求也更小,耗能也更小。凭证各公司的大、小模子产物对比来看,小模子价钱较低。凭证Artificial Analysis的统计,美国AI公司主流“小模子”中,GPT-4o mini的价钱*,在无需处置庞大义务的“通俗用户”中或许将更受迎接。

低价来自成本的降低。阿尔特曼在推特上发文指出,2022年天下上*的模子text-davinci-003,它比GPT-4o mini差得多,但成本要贵上100多倍。这一波OpenAI争先结构小模子,就是想通过显著降低AI使用成本,扩大AI使用局限。

泉源:阿尔特曼推特截图

低成本、低性价比、更广用户适配度,小模子不仅能成为AI公司们to C端的有力手段,更是AI价钱战的应对神器,或将成为下一个新风口。

今年年头,2024百度AI开发者大会上,李彦宏提出未来大型的AI原生应用都是巨细模子的混用。他还示意,用户基于百度文心4.0,可以天真剪裁出适用于差异场景的小尺寸模子,“在一些特定场景中,经由精调后的小模子,其使用效果甚至可以媲美大模子。”

外洋GPT-4o、Llama 3.1轮流轰炸,海内“千模大战”大浪淘沙,无论开源照样闭源,高价照样低价、大模子照样小模子,这波AI浪潮最后的胜者还未展现。

参考资料:

扎克伯格《Open Source AI is the Path Forward》,原文链接:

Meta《Meta Large Language Model Compiler: Foundation Models of Compiler Optimization》,原文链接:

《硅谷AI守护战打响!最强4050亿开源模子Llama 3.1上线,OpenAI:GPT-4o mini免用度》,钛媒体

————正大国际期货金融有限公司